クリエイティブとAI技術(Artificial Intelligence Technology、以下AI)の融合から生まれた“CG女子高生”Saya(サヤ)。3DCGで描かれ、表情認識AI、視線認識AIを巧みに取り入れた実写のようにリアルな女子高生が、2018年3月にアメリカ・オースティンで開催された「SXSW Trade Show」で衝撃的なデビューを果たし、多くの来場者を驚かせました。技術面でチームをけん引したテクニカルディレクターの中原玄太に開発の裏側についてうかがいました。

AI×クリエイティブ ―― その可能性を追求したいと思った

僕は現在博報堂のビジネスインキュベーション局所属で、普段はマス広告のみならず、旧来の広告文脈では語られない新たなビジネスモデルにチャレンジするような業務に携わっています。もともと大学院で数学を専攻しており、博報堂に来る前は金融工学の会社でプログラミングベースの近似計算によるプライシング(値付け)の仕事をやっていたのですが、2012年に博報堂に入社し、初めて統計を使ったマーケティング手法というものに触れて、新鮮さ、面白さを感じていました。そんな折、プライベートでRhizomatiksの真鍋大度さん、Qosmoの徳井直生さんが主催する「2045」というクラブイベントに参加し、そこで衝撃を受けました。イベントでは、参加者のプレイリストを同期、曲のジャンルを解析してAIに選曲させたり、AIとDJが交互に曲をつないでいくといった実験的な試みがなされていて、AIや数学がクリエイティブの世界を拡張するのを目の当たりにしたわけです。そこからクリエイティブへのAIの活用にぐっと興味が増していきました。

縁あってその後Qosmoの徳井さんと面識を得て、個人的にAIのことを教わったり、Rhizomatiksの方の社内講演を聴講、openFrameworksというフレームワークを活用したライブ演出方法などについて知り、CGでは何日もかかるような表現がリアルタイムで可能になることに非常に感銘を受けました。数学を学んだ人間にとっては、ビジュアルコーディングやAIモデルの学習って、普通の人より多少敷居が低いかもしれません。なので早速、趣味のような感覚で、自分でもopenFrameworksを使っていろいろと試してみるようになりました。社内のワークショップでもプログラミングベースのアウトプットを使って課題を提出したり、友人のミュージシャンにミュージックビデオをつくったりしていました。

長くなりましたが(笑)、2017年の5月、僕のそんな活動を知ったSayaの博報堂内のプロデューサーから「チーム内にAIに詳しいメンバーがいないので、Sayaチームにレクチャーしてほしい」と言われたのが、僕とチームとの最初の接点でした。

Sayaを成長させていくきっかけとなったクリエイティブディレクターの想い

そもそも、SayaプロジェクトにAIを活用していくことになったのは、プロジェクトのクリエイティブディレクターであるTBWA\HAKUHODOの新沢崇幸さんのアイデアから始まりました。

新沢さんは、Sayaを初めて見た時に「これは単なるCG美少女キャラクターで終わらせてはいけないのではないか」という直感があったそうです。Sayaにはキャラクターを超えたアイコンになり得るような、ある種の象徴性がある。現代テクノロジーの先端を走る存在としてシンボリックに打ち出すことができるのではないかと考えていました。そこで、Sayaの生みの親である、CGアーティストの石川晃之さん、友香さん夫妻のユニット「TELYUKA」(テルユカ)さんに、Sayaにさまざまなテクノロジーを融合させて身体化させていくこと、また認知を広げることでキャラクターとしても進化する、「成長するコンテンツ」として開発していくというコンセプトをご提案されていました。技術を統合して新しいものをつくるという話に、TELYUKAさんにも共感していただくことができ、このプロジェクトはスタートしています。

僕がSayaチームに入った時は、このようにプロジェクトにAIを活用することはほぼ決まっていましたが、具体的に何からどう進めるかを検討している段階でした。そこで僕は、AIのクリエイティブに特化していて、AIを使ったメディアアートも多数発表しているQosmoの徳井さんに協力を依頼してはどうかと提案。 またそのタイミングで、僕のチームへの本格的な参加も決まりました。

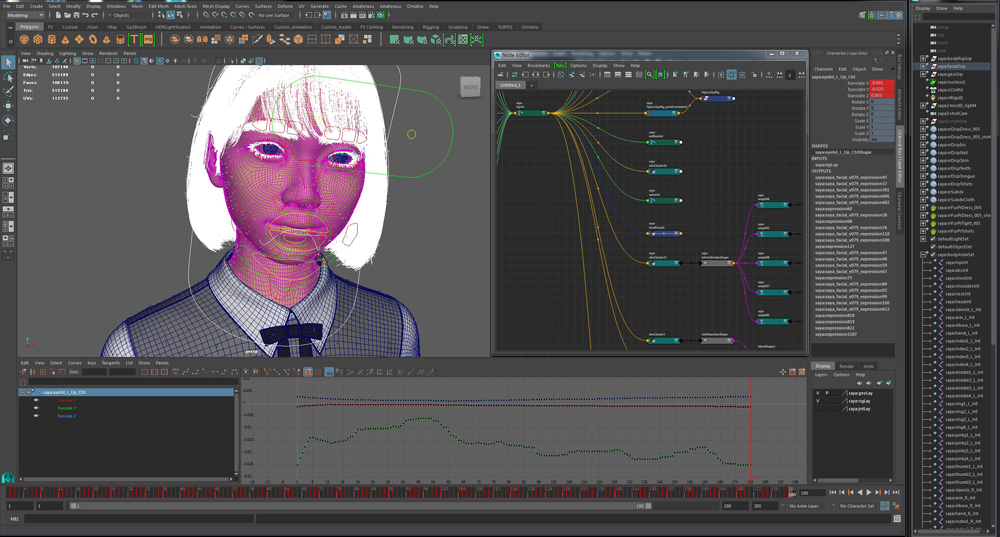

AIを活用するにあたり、まず頭に浮かんだのは「言語」。つまり「Sayaに何かをしゃべらせてみよう」ということです。でも言語って、実は(笑)すごく難しくて、かつ口の動きと音声を合わせるのも至難の技。見た人をびっくりさせるには別の方法がいいのでは?という話になりました。そこで浮かんだのが感情によるコミュニケーションにおける表情認識AIの活用です。すごく高画質の映像って、1秒の素材をつくるにもレンダリングに数時間はかかるんです。それほど時間がかかるはずのことが、見ている人の表情や動きに応じて即時的にどんどん変化していけば、映像技術についてある程度知っている人にはマジックに見えるだろうし、技術がわからない人にとっても、高画質の映像がリアルタイムでインタラクティブに反応してくれるという、未体験の驚きがあるだろうと。リテラシーのあるなしにかかわらず、誰にとっても面白いものができるのではないかと思いました。

技術がわかる人にもそうでない人にも、等しく「驚き」を提供できた

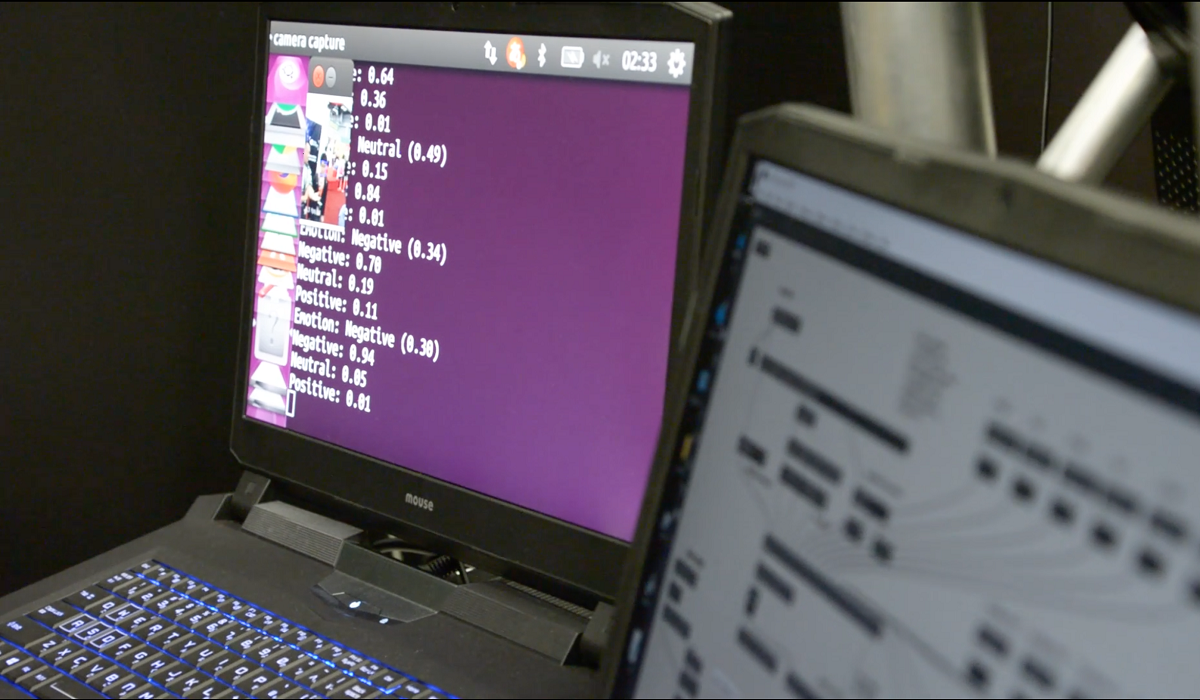

Sayaを出展した「SXSW Trade Show」(以下SXSW)で具体的に行ったことは、まず体験者の顔を7つくらいの表情に分類し、「喜び70、心配20、驚き10」といった感じに、合計が100になるように分布を書きます。

撮影した体験者の顔の画像をリアルタイムで分析し、それぞれがある閾値を超えると目の前の映像がチェンジする仕組みになっています。体験者にとっては、自分の表情に対して瞬時にSayaが「はにかむ」「目をそらす」といった自然なリアクションを返してくれるわけです。また体験者には、Sayaが映し出される94インチのモニターの前に立ってもらうわけですが、Sayaは特にブースのようなもので仕切られてはいません。周囲にどれだけ人がいても、目の前にいる体験者本人の顔だけを認識するようになっている。これは開発における大きなブレークスルーのおかげでした。また準備が間に合わなかったのですが、CGと人が目線を合わせるという体験もつくりだしたいとも思ってました。ここだけの話(笑)、体験者の目線を高い精度で追える解析AIの準備も、裏でちゃっかりしていました。いつか日の目を見れるといいですね。

あまり詳しいことは語れませんが、いずれにしても先端的な技術をいくつも組み合せ、さらにはたくさんの細かい工夫を施し、そしてコンピューティングパワーを駆使することによって、あのSayaというインタラクティブが成立しているんです。

SXSWへの出展を目指したのが2017年の下期くらい。そこから本格的に開発を始め、約半年でSXSWにて公式なお披露目となりました。サウスバイでは、技術好きな人からは「これどういう仕組みになってるの?」という反応、CG好きな人には「ここまでリアルな人間が表現できるなんて」という反応、また子どもたちなど、純粋にエンターテインメントを楽しみに来た方々には、リアルタイムで自分たちの表情に反応するSayaを楽しんでもらうことができました。こちらが願っていた、お客さんを限定することなく、それぞれの人からいい反応をいただくことができた。うまくいってすごくよかったなと思います。

SXSWで沢山の方に体験して頂いたことによるフィードバックも開発に活かしています。Sayaに手を振ったりされる方が多く見受けられたことから、体験者の身振り手振りに反応できるように、骨格認識AIを活用して手を振り返すインタラクションなどをその後にアップデートしました。

Sayaを多様性のシンボルに!これからは社会貢献の文脈でもAIを活用していくべき

プロデュースサイドの夢ではありますが、Sayaが言語、非言語問わず、みんなのコミュニケーションに役に立ちたい、多様性のシンボルになればと考えています。というのも、非言語コミュニケーション分野におけるAI活用ってまだ伸びしろが大きく、ぜひこれから新たな挑戦をしていきたいと考えているんです。まだ挑戦中なので詳しいことは恥ずかしくて言えませんが(笑)、上手くいくと新たなコニュニケーションの手助けになるかもしれません。そうした社会貢献も、AIの力で今後取り組んでいくことができるのではないかと思っています。

Saya プロジェクトは、技術面でほぼ内製していて、広告会社として珍しい、非常に新しいチャレンジになっているのではないかと思います。これは優秀なチームメンバーのおかげでして、いま上手くいっている大きな要因はテックメンバーのリクルーティングの成功にあったと言っても過言ではないかもです。

AIの活用は、広告表現においても非常に大きな可能性を秘めています。いまのAIの仕組みは人間の脳と非常に似ていて、たとえば学習の仕組みは、赤ちゃんの「ママ」を覚えるのと同じで、偶然「ママ」と言った瞬間に母親が喜んだ反応をすることから、赤ちゃんは「ママ」=○と正解タグが付いたデータセットから言語を学んでいく。判別に関してもそうで、人もAIもたくさんのデータから特徴量を抽出し、初めて見るものに対しA=〇〇である、ということを判断する。そのようなAIの特徴を活かせば、体験者のインプットに合わせて、次のアクションを出しわける適切なトリガーになるし、広告の新しい表現に役立てることができると思います。僕のような仕事内容は広告会社においてはまだ珍しいかもしれませんが、みんな興味のなかった砂利道を舗装してるイメージで、次の誰かの選択肢が先々少しでも広がったらいいなと考えています。Sayaプロジェクトを通して、そうした新しい広告の可能性も皆さんに感じてもらえたら嬉しいですね。

テクニカルディレクター 中原玄太

熊本県牛深市(現、天草市)生まれと育ち。

主な著書に「EXCELでわかるLIBORディスカウントとOISディスカウント」(きんざい)、

主な論文に「A NOTE ON NEW CLASSES OF INFINITELY DIVISIBLE DISTRIBUTIONS ON R^d」(Elect. Comm. in Probab.)、

主なMV制作に「死神ナイトフィーバー / 杉本ラララ」(lalala music)、

好きな言葉は「言葉はさんかく こころは四角」。